Envision: et skritt inn i framtidens synshjelpemidler?

Innledning

Da Microsoft- appen Seeing AI kom var det helt magisk for meg. Endelig kunne telefonen brukes for å få ordentlig hjelp til ulike se-ting. Jeg var såpass gira på å teste appen at jeg laget en amerikansk Apple-konto for å få tak i appen. Det tok en stund før den ble tilgjengelig i norsk App Store. Seeing AI har nå flere funksjoner enn da den kom, og for meg har «øyeblikkelig tekst» vært det jeg har hatt aller mest nytte av.

Etter hvert begynte jeg å bruke appen SuperSence med raskere øyeblikkelig tekst-funksjon enn Seeing AI. Raskere, kanskje mindre nøyaktig, men for eksempel når jeg står og venter på en bussholdeplass og skal sjekke hvilken buss som kommer er det nødvendig med veldig rask gjenkjenning. Når jeg står der på bussholdeplassen med telefonen leses all mulig tekst opp: skilt på biler som passerer, alskens tekst i omgivelsene og nesten alltid hvilken buss som kommer. Det er ikke alltid hele buss-tittelen leses, men det skjer nesten aldri at jeg ikke får nok info til å gå på eller stoppe riktig buss. Det krever trening for å peke kameraet riktig og forstå all den tekstgjenkjenninga, men det har gjort kollektivreiser mye mindre stressende for meg. Jeg bruker Ruter for å sjekke sånn ca. når bussen kommer. Når det er igjen et par minutter begynner jeg å gjenkjenne tekst. Selv noen minutter gjør deg ganske pling i bollen hvis det er mye trafikk og tekst i omgivelsene.

Det neste store framskrittet var Be My AI. Det er en funksjon i appen Be My Eyes. Denne appen gjør det først og fremst mulig å ringe opp hjelpere som kan bistå med seende assistanse. Rett og slett videosamtale, altså. En fantastisk fin app. Terskelen min for å ringe tilfeldige folk er imidlertid ganske høy. I 2024 kom Be My Eyes med en ny funksjon som gjør at du kan ta et bilde, få detaljert beskrivelse og i tillegg spørre om detaljer. Jeg elsker den funksjonen og har fått hjelp til veldig mange ting!

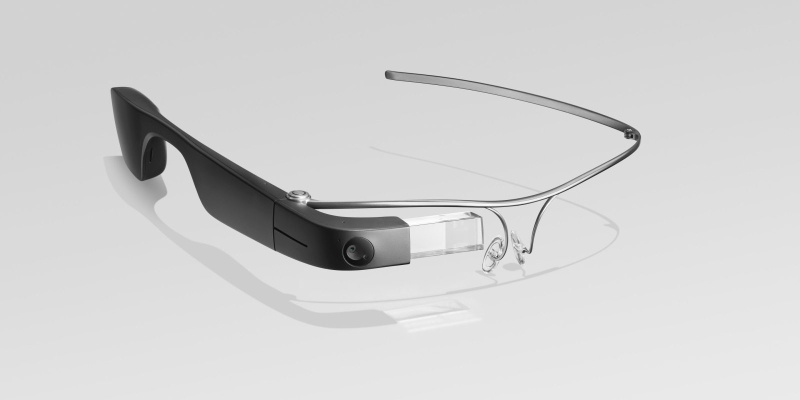

Det finnes mange apper som kan kompensere litt for manglende syn (mange flere enn de få jeg har nevnt her). I løpet av de siste månedene har jeg nesten gått helt over til å bruke appen Envision. Er det fordi den er best til alt? Neppe, men appen representerer state of the art, og det er videreutvikling kontinuerlig. Appen har mange funksjoner, og for meg er det nok at jeg rett og slett liker den. I tillegg til Envision AI-appen kan du koble til et kamera som er montert på en innfatning (Envision glasses). Brillene er kostbare og utvikles av Envision. Dvs. brillene er fra Google, men funksjonalitet og brukergrensesnitt lages altså av Envision.

NAV har fått søknader om Envision Glasses og ønsket å vurdere om dette er et hensiktsmessig hjelpemiddel. Siden jeg jobber i NAV IT og hadde sendt inn søknad ble jeg bedt om å teste brillene. Jeg har i tillegg sett på appen. Jeg har kun testet brillene som en blind mann, ikke vurdert personvern, politikk eller noe utover det å bruke brillene.

Dette notatet er en oppsummering av mine erfaringer med Envision AI, Envision Glasses og kombinasjonen app/brille.

Testing

Testingen har gått ut på at jeg rett og slett har brukt brillene og appen når jeg trenger det. Jeg har med andre ord ikke konstruert testingen for å prøve funksjonene en etter en. Tanken min med å gjøre det sånn var at testene blir mer varierte og ikke minst ekte. På den måten har jeg også avdekket hvilke funksjoner jeg ikke bruker. Akkurat det kan selvsagt variere fra person til person: antar at det har vært en prosess for å finne ut hvilke funksjoner som skal implementeres.

Det er to hovedmål med testingen:

- Vurdere om Envision Glasses fungerer bra. Hjelpemiddelsentralen ønsker ikke å låne ut dyre produkter som ikke fungerer.

- Unngå å skape «falske forhåpninger». Det å være blind eller ha en stor synsnedsettelse er en betydelig funksjonshindring. Hjelpemidler som kan kompensere for denne funksjonshindringen kan føre til at mennesker får alt for store forhåpninger. Derfor er det viktig å ha god kunnskap om hvilke egenskaper hjelpemidler har og hva som bør være på plass for at hjelpemiddelet kan bli hensiktsmessig.

Om notatet

Notatet er delt inn i fire hoveddeler:

- Ray-Ban Meta Glasses

En kort beskrivelse av Meta Glasses. Ikke en del av testingen, men viktig å følge med på det som skjer innen mainstream-teknologi også. - Envision AI

I denne delen beskrives appen og de funksjonene jeg har testet. - Envision Glasses

I denne delen beskrives brillene og de funksjonene jeg har testet. - Oppsummering

Her prøver jeg å lage en oppsummering av mine erfaringer.

Funksjonene på briller og app

Det er mye overlapp mht. hvilke funksjoner som finnes i appen og brillene. Dette er vist i tabellen under. Funksjonsnavnene varier litt med ulike versjoner, så det kan finnes noen små og ubetydelige avvik i navnene.

| Funksjon | Brille | App |

|---|---|---|

| Øyeblikkelig tekst | X | X |

| Skann tekst | X | X |

| Bibliotek og Importer en fil | - | X |

| Skann strekkode | - | X |

| Beskriv scenen | X | X |

| Utforsk | X | X |

| Finn objekter | X | X |

| Finn folk | X | X |

| Oppdag farger | X | X |

| Skann QR | X | X |

| Ring en ally | X | - |

| Gjenkjenn kontanter | X | - |

| Oppdag lys | X | - |

| Ring en Aira-agent | X | - |

| Batch skann | X | X |

Ray-Ban Meta Glasses

Disse brillene har fått en del oppmerksomhet av blinde og sterkt svaksynte i det siste. Det viktigste bruksområdet for solbrillene er opptak av bilder, video og videosamtaler. Brillene kan imidlertid også kobles opp mot Meta AI (Meta KI). Riktignok er ikke kunstig intelligens tilgjengelig i Norge enda, men det er relativt enkelt å få det på plass ved hjelp av VPN (selvsagt mulig å bruke andre klienter). Takk til Cliff Isaksen som la ut en fin framgangsmåte i Mortens teknologigruppe på Facebook.

- Last ned Meta View appen, følg instruksjonene og koble til brillene.

- Last ned TunnelBear, opprett konto og koble til USA

- Gå inn i Meta View mens VPN er koblet opp.

- Koble til Meta KI i appen

- Nå kan du koble fra VPN igjen.

Når du har koblet til Meta KI kan du spørre brillene "Hey Meta Look and dscribe what I'm seeing", "Hey Meta. Look and read" og så videre. Meta glasses er mer responsive enn Envision Glasses, men forklaringene er mindre detaljerte. Du kan imidlertid stille oppfølgingsspørsmål, og jeg har alt hatt stor glede av brillene. Det å kunne ringe noen og skru på video i Messenger er også nyttig: da har du plutselig mange å ringe til!

En ting mange vil like med Meta Glassesmange vil like med er at de ser ut som normale solbriller (eller briller, mine har blanke glass). En annen veldig fin greie med Meta er at du får tilgang til generell KI (ikke bare bildebeskrivelser), så du kan spørre om hva som helst. Meta KI er antakelig ikke på høyden med ChatGPT, men nyttig er det!

Meta Glasses fungerer også fint til opptak av video og bilder for synshemmede. Sammenliknet med å holde telefonen riktig er det mye enklere å få riktig utsnitt med brillene på nesa.

Meta Glasses er nyttige, og et spennende produkt. Helt på høyde med Envision er de likevel ikke som synshjelpemiddel. Du har for eksempel ikke opplesing av øyeblikkelig tekst.

Envision AI

Appen er gratis og har mange av de samme funksjonene som Envision glasses.

Appen har tre faner:

- App

Denne fanen inneholder funksjonene som gjennomgås nedenfor. - Envision glasses

Sammenkobling, brille-innstillinger, batteristatus, tilkobling til Wi-Fi og hjelp. - Innstillinger

App-innstillinger, støtt Envision, skriv en anmeldelse med mer.

Funksjoner

- Øyeblikkelig tekst

- Skann tekst

- Bibliotek og Importer en fil

- Skann strekkode

- Beskriv scenen

- Utforske

- Finn objekter

- Finne folk

- Oppdag farger

- Skann tilgjengelig QR

Funksjonene kan vises i en hovedmeny eller som et valg i «flere funksjoner». Min erfaring er at det er lurt å legge bare de valgene du bruker ofte i hovedmenyen. Andre valg er uansett lette å finne i «flere valg». Rekkefølgen i menyen kan tilpasses slik du vil ha det. Nedenfor følger en kort forklaring av hver funksjon og mine erfaringer med funksjonene.

Øyeblikkelig tekst

Leser opp tekst du peker på med kameraet.

Eksempler på tekst som ble gjenkjent:

- Oppstart av pelletsgrill: I oppstarten skal du trykke på en knapp og stille inn temperatur. Dette går fint når du gjenkjenner teksten i displayet. Etter oppstart styres alt med en app.

- Sjekke hvilken buss som kommer (mye mer behagelig med brillene).

- Sortere post

- Finne ut hva ulike matvarer er

- Teksting på TV (mer behagelig med brillene, for eksempel. Hvis du spiser, og mye mindre slitsomt)

- Lesing av info-tavle på jobben (der fungerer brillene mye bedre til mitt behov fordi jeg ofte gjør noe med hendene samtidig, for eksempel. Fyller på kaffe)

- …

Dette er den funksjonen jeg har brukt desidert mest. Jeg tenker at funksjonen ikke er laget for lesing av bøker, brev eller store mengder tekst, men at den egner seg for rask teksgjenkjenning.

Eksempler på tekst som ikke ble gjenkjent:

Gitt gode lysforhold blir stort sett tekst gjenkjent, ikke nødvendigvis helt riktig, men som oftest (alltid?) nok til å finne ut av ting.

Skann tekst

Tradisjonell OCR med hjelp for å plassere siden riktig.

Jeg har scannet noen brev med veldig godt resultat. Har ikke scannet bøker eller andre trykksaker. Om resultatet er bedre eller dårligere enn andre produkter har jeg liten erfaring med. Normalt har jeg ganske lite behov for skanning, men samtidig er det en funksjon som er helt uunnværlig av og til.

Bibliotek og Importer en fil

Lagre filer eller importere filer/bilder for gjenkjenning.

For meg er det mindre hensiktsmessig å bruke biblioteket til lagring enn for eksempel skytjenester. Jeg har ikke hatt mye behov for å importere filer. Jeg har derimot hatt nytte av å hente bilder og få detaljert beskrivelse. Du kan overføre scannet tekst fra brillene, men dessverre ikke bilder. Hvis du har tatt et bilde du tenker at det kan være nyttig å ha ville det ha vært fint å kunne overføre bilder også. Dette er en funksjon jeg håper (og tror) vil komme, og jeg kan ikke skjønne at dette har spesielle konsekvenser i forhold til personvern (du kan jo ta et bilde med kameraet på telefonen).

Skann strekkode

Oversetter strekkoder til tekst (gjenkjenner produkter).

Du må bevege kameraet rundt til den oppdager strekkoden. Det er ikke alltid så lett.

Eksempler på ting som ble gjenkjent:

- Ibux

Eksempler på ting som ikke ble gjenkjent:

- Nudler (kjøpt i innvandrerbutikk)

- Juice-flaske

Det finnes produkter som er bedre på gjenkjenning av strekkoder som brukes i Norge enn Envision-appen. Samtidig ser det ut som det gjøres en god jobb mht. lokalisering, og derfor er det lov å håpe på forbedringer av denne funksjonen.

Beskriv scenen

Ta et bilde og få en detaljert forklaring.

Innledningsvis skrev jeg litt om funksjonen Be My AI. Dette er en helt tilsvarende funksjon, men beskrivelsene kommer på Engelsk.

Eksempler på nyttige beskrivelser:

- Bryterpanel på vakuummaskin: Jeg husket ikke hvordan maskinen skulle brukes. Beskrivelsen av bryterpanelet var kjempegod, og det gikk helt fint å bruke maskinen. Før jeg fikk beskrivelsen hadde jeg prøvd meg fram uten hell!

- Matvarer: mange av beskrivelsene har vært helt suverene og fungerer bedre enn både «øyeblikkelig tekst» og «skann tekst».

Eksempler på mindre nyttige beskrivelser:

I appen kommer beskrivelsene på engelsk. Det kan være vrient å skjønne alt synes jeg. Antar at dette rett og slett er en feil som kan rettes siden brillene gir norske beskrivelser (jeg har rapportert dette som en feil). Hovedgrunnen til at beskrivelsene er vanskelige å forstå er at engelsk leses med norsk talesyntese.

Jeg har ikke opplevd at beskrivelsene jeg får har vært uriktige, dvs. en gang ble førerhunden min (en brun schæfer) forvekslet med en katt da den var ca. 8 meter borte og i tett skogsterreng (krattskog). I noen tilfeller har det imidlertid ikke vært all verdens å trekke ut av beskrivelsene. Du kan stille oppfølgingsspørsmål og noen ganger har det gitt meg den informasjonen jeg ønsket, men ikke i 100% av tilfellene.

Utforske

Få beskrivelser av objekter som fanges opp av kameraet.

Denne funksjonen har jeg testet, men den er i praksis mye nyttigere for meg på brillene. Jeg har brukt funksjonen på telefonen et par ganger for å sjekke hvor en dør er når jeg er i et ukjent lokale.

Finn objekter

Gjenkjenner valgte objekter som identifiseres av kameraet.

Denne funksjonen har jeg ikke brukt. Den kan eksempelvis brukes for å finne en stol, trafikklys, bord, lysbryter, …

Finne folk

Identifiserer folk som er lagt inn og gitt navn.

Folk du vil gjenkjenne legges inn ved å ta fem bilder med Envision-appen. Når noen er lagt inn synkes det også til brillene.

Oppdag farger

Fargegjenkjenning der du bestemmer detaljnivå.

Det er nyttig å kunne gjenkjenne farger for eksempel for å kunne sortere klesvask. Funksjonen er fin på den måten at du kan bestemme detaljnivå. For sortering av klesvask er nok den minst detaljerte varianten enklest. Det blir lett mange farger på et plagg, og det kan til og med være en treningssak å avgjøre om noe er lyst eller mørkt. I tvilstilfeller kan det faktisk være enklest å bruke funksjonen «Beskriv scenen», som ofte gir en veldig god beskrivelse. Gjenkjenn farger er mer krevende enn tradisjonell fargegjenkjenner for blinde (som du holder helt inntil det du ønsker fargen på).

Skann tilgjengelig QR

Dette er en funksjon jeg ikke har brukt. Det er imidlertid nokså enkelt å lage QR-koder, og jeg kan tenke meg at dette for eksempel kan brukes som et merkesystem. Selv benytter jeg punktskrift eller NFC-tagger til merking.

Envision glasses

Generelt

Brillene kan brukes frittstående fra mobilen, men du trenger en mobil for å gjøre ulike innstillinger (for eksempel koble til nettverk). De fleste funksjonene er avhengig av nettverk, men du kan bruke delt nettverk på mobilen. Akkurat det synes jeg er litt rart. Er brillene koblet til mobilen burde det egentlig være mulig å la Envision AI ta seg av kommunikasjonen. Her er det garantert et eller annet teknisk jeg ikke har oversikt over.

Nedenfor har jeg satt opp noen generelle synspunkter med brillene. Det altoverveiende inntrykket jeg har er at Envision Glasses svarer til forventningene jeg hadde da jeg søkte NAV og at de fungerer slik brillene beskrives på leverandørens nettsider.

Bra:

- Brukergrensesnitt

- Effektivt å kombinere bruk av ulike funksjoner

- Stabilitet (jeg har ikke hatt krasj eller ustabilitet på andre måter)

- God gjenkjenning og bedre egnet enn mobilen i en del situasjoner

- Helt OK å ha på og gjør at hendene kan brukes fritt

- Videreutvikles hele tiden

Dårlig:

- Batterikapasitet

- Volum (det er mulig å koble til headset)

- Kameraet kan lett falle av innfatningen

- Kamerakvalitet (jeg er ganske sikker på at neste generasjons briller har et mer lyssterkt og høyoppløselig kamera)

Noen vil helt sikkert mene at brillen er lite diskre. Dette stemmer, og jeg har fått mange spørsmål når jeg har brukt Envision glasses. For min del har det ført til mer positivt enn negativt. Jeg har fått mulighet til å forklare hva brillene kan brukes til, og på jobben har jeg kommet i kontakt med helt nye kollegaer. Jeg har derfor ikke ført opp dette som negativt, men skjønner at andre føler det annerledes enn meg.

Kort om brukergrensesnitt

Envision Glasses styres med et touch-panel på høyre side mot fronten. Brukergrensesnittet består i prinsippet av en trestruktur:

- Hovedmenyen

- Aktiver (hver enkelt funksjon)

- Undermenyer (kontekstsensitiv meny som finnes for noen funksjoner)

Det er to typer fingerbevegelser: sveip og trykk.

| Fingerbevegelse | Beskrivelse |

|---|---|

| Sveip fremover | Neste eller øk verdi |

| Sveip bakover | Forrige eller reduser verdi |

| Sveip ned | Avbryt / gå tilbake |

| Sveip ned med to fingre | Gå til Hjem |

| Sveip opp med to fingre | Gå til volum |

| Trykk med en finger | Pause / les menyvalg |

| Dobbelttrykk med en finger | Velg (aktiver) |

| Trykk og hold med en finger | Kontekstsensitiv hjelp |

| Enkelttrykk med to fingre | Innstillinger for den aktive funksjonen |

Parring og tilkobling til nettverk

For meg var det uproblematisk å koble brillene til telefonen. Det gjøres med en veiviser i Envision AI.

Tilkobling til trådløst nett kan gjøres ved å opprette en qr-kode. Først tenkte jeg at dette var fryktelig tungvint, men det fungerer greit:

Du skriver inn passordet og det lages en qr-kode. Koden leses så av brillene og tilkoblingen er på plass.

Jeg har brukt følgende nettverk i testingen:

- Privat hjemmenett

- Privat nettverk på campingvogn

- Privat nettverk på hytta

- Delt internett på iPhone

- NAV-mob (på jobb)

Tilkobling av headset gikk relativt greit. Jeg har brukt Aftershokz noen få ganger i kombinasjon med brillene. Har måttet prøve noen ganger for å få sammenkoblingen på plass. Det bør legges til at jeg har måttet prøve flere ganger også når jeg sammenkopler Aftershokz med telefonen.

Funksjoner

- Øyeblikkelig tekst

- Beskriv scenen

- Ring en ally

- Utforske

- Skann tekst

- Gjenkjenne kontanter

- Oppdag lys

- Oppdag farger

- Finn objekt

- Ring en AIRA-agent

- Batch skann

- Finne folk

- Skann qr-kode

Funksjonene kan vises i en hovedmeny eller som et valg i «flere funksjoner». Min erfaring er at det er lurt å legge bare de valgene du bruker ofte i hovedmenyen. Andre valg er uansett lette å finne i «flere valg». Rekkefølgen i menyen kan tilpasses slik du vil ha det. Nedenfor følger en kort forklaring av hver funksjon og mine erfaringer med funksjonene.

Øyeblikkelig tekst

Leser opp tekst du peker på med kameraet.

Eksempler på gjenkjent tekst:

- Stå på bussholdeplass og sjekke hvilken buss som kommer.

- sjekke om det står noe på PC-skjermen (evt. Også hva, for eksempel. I oppstarten)

- Krydderbokser og andre matvarer

- taxi (sjekke at en bil faktisk var en taxi siden sjåføren ikke kom ut)

- Info-skjermer på jobben. Veldig fint å kunne få med seg infoen: den er faktisk ikke tilgjengelig på noen annen måte enn på disse skjermene!

Eksempler på tekst som ikke ble gjenkjent:

Gitt gode lysforhold virker det som tekst blir gjenkjent, men som nevnt ser jeg for meg at kameraet kommer til å bli bedre (mer lyssterkt og høyre oppløsning) når maskinvaren kommer i neste versjon.

Beskriv scenen

Ta et bilde og få en detaljert forklaring.

Denne funksjonen har jeg brukt mye, og det har både vært nyttig og faktisk også til stor glede vil jeg si. Endelig har jeg et mye bedre inntrykk av nærområdet hjemme, jeg kan beskrive hvordan bygget på jobb ser ut (for taxi-sjåfører) og så videre!

Eksempler på nyttige beskrivelser:

- Ny (for meg) HC-WC: Fikk flott beskrivelse og trengte ikke lete etter WC, vask, pspit oh dåpr.

- Airfryer: sjekke hvilken temperatur som var stilt inn. Her fikk jeg først en god beskrivelse, og med oppfølgingsspørsmål fikk jeg lest opp riktig temperatur (det var masse annen tekst i displayet).

- Bilder i nærmiljøet der jeg bor som rett og slett har gjort meg mer kjent.

- Gatearbeid. Jeg tok bilde, spurte og skjønte at det var greit å gå på fortauet på den siden av gata jeg gikk.

- Bilde av arbeidsplassen. Gjort det enklere å forklare hvor taxier skal stoppe.

- … jeg har rett og slett brukt denne funksjonen masse og føler at den er veldig verdifull …

Eksempler på mindre nyttige beskrivelser:

Jeg har ikke opplevd at beskrivelsene jeg får har vært uriktige. I noen tilfeller har det imidlertid ikke vært all verdens å trekke ut av beskrivelsene. Du kan stille oppfølgingsspørsmål og noen ganger har det gitt meg den informasjonen jeg ønsket, men ikke i 100% av tilfellene. Og i noen tilfeller har jeg jo også bare tatt bilder for å sjekke det som er rundt meg. I en skog kan det da for eksempel. Være beskrivelser av vegitasjon og så videre. En gang jeg prøvde fikk jeg beskjed om at det var røde bær, og jammen fant jeg ikke viltvoksende bringebær (kanskje ikke veldig nyttig, ikke nok til å bli bærsanker, men morsomt var det)!

En ting som trekker ned er at ChatGPT har noen spesielle begrensninger. Du kan eksempelvis ikke spørre om hudfarge. Du kan heller ikke spørre om bilmerker eller merker på andre produkter. Denne typen informasjon har alle som ser lett tilgang til, og i flere situasjoner har jeg irritert meg over svaret: «… jeg kan dessverre ikke gi informasjon om hydfarge, merker og så videre».

Ring en ally

Videosamtale med seende hjelpere.

Du kan ringe en ally (kontakt) rett fra brillen og ha en videosamtale. Ally’er legges til I Envision-appen. De som ønsker å være kontakter laster ned appen Envision Ally og inviterer den de ønsker å hjelpe. Dette blir altså mye likt «Be My Eyes», men videosamtalen blir rett fra Envision Glasses.

Videosamtaler fungerer fint og for meg har det vært mye enklere når jeg kan ringe folk jeg kjenner. Dette er mulig i Be My Eyes også, men jeg fikk det ikke til å fungere da jeg prøvde (og har ikke prøvd igjen). Det er absolutt en del situasjoner der det er mye bedre å ringe med Envision enn med mobilen:

- Når du er ute og går med hund eller stokk

- Hvis begge hendene er opptatt

- Hvis du må holde bildet stødig for at noen skal se små detaljer. På den annen side er det mange ganger enklere å gå helt nært innpå noe med mobilen.

Med Envision-appen kan du ikke foreta videosamtaler, så skal du bruke mobilkameraet for å få hjelp (altså uten brillene) er Facetime, Be My Eyes og så videre løsningen.

Jeg har lagt in 5 personer jeg kan ringe til fra brillen.

Eksempler på gode videosamtaler:

- Guiding til et møterom på jobben: fikk hjelp av en som er godt kjent i bygget og gikk riktig uten problemer.

- Innstilling av temperatur på en gammeldags ovn. Måtte gå ganske nær, men da gikk det fint.

Eksempler på dårlige videosamtaler:

- Ingen, men jeg har måttet skru på lyset.

De andre funksjonene på brillene er såpass gode at jeg ser for meg at videosamtaler blir nokså sporadiske. Likevel er dette en funksjon jeg er veldig glad for å ha.

Utforske

Få beskrivelser av objekter som fanges opp av kameraet.

Da jeg fikk brillene var programvareversjonen gammel (noterte ikke versjonsnummeret). Jeg prøvde Utforsk-funksjonen. Den oppdaget ganske lite synes jeg. Etter oppdatering var det store forbedringer. Langt flere objekter blir oppdaget. Har du på brillene i fart blir det en del feil, for eksempel er det veldig mange «krakker» og «anleggsområder» i området der jeg bor i følge brillene. Krakkene finnes imidlertid ikke, og jeg tror den tar feil av murer/gjerder eller noe liknende.

Det kommer hyppige oppdateringer til Envision Glasses. Jeg tipper at Utforsk er en funksjon der ytelsen kommer til å bli bedre, og det kan skje veldig raskt med den utviklingen som er innen maskinlæring og KI. Jeg har hatt nytte av denne funksjonen for å:

- Finne dører (gå ut av et ukjent rom)

- Lokalisere dør (for å gå inn i en butikk)

- Lokalisere vinduer (for å få inn litt luft, også ukjent rom selvsagt)

- Finne stoler

Skann tekst

Tradisjonell OCR med hjelp for å plassere siden riktig.

Skanning fungerer fint, og når du har vendt deg til hvor teksten skal plasseres (armlengdes avstand og litt mot høyre) går det raskt å scanne. Om resultatet er bedre eller dårligere enn andre produkter har jeg liten erfaring med. Normalt har jeg ganske lite behov for skanning, men samtidig er det en funksjon som er helt uunnværlig av og til.

Gjenkjenne kontanter

Identifiserer hva slags seddel (i valgt valuta) som vises i kameraet.

Dette er en funksjon jeg ikke har hatt bruk for, men jeg har testet gjenkjenning av noen norske sedler. Det har gått greit. Muligens kan en «gjenkjenn kontanter»-funksjon være mer aktuell på utenlandsreiser eller dersom du en eller annen gang mottar kontanter (selv har jeg brukt bare kort eller telefon i veldig mange år).

Denne funksjonen finnes ikke i Envision-appen.

Oppdag lys

Lydsignal med lysere lyd desto mer lys.

Denne funksjonen har jeg hatt god nytte av:

- Sjekke om alt lys er slått av på hytta.

- Sjekke om indikatorlys er av/på

- Sjekke om lyset på kontoret fungerer eller ikke (ustabil sensor)

- …

Denne funksjonen finnes ikke i Envision-appen, men det finnes andre apper som har lysdetektering (eks. Microsoft AI).

Oppdag farger

Fargegjenkjenning der du bestemmer detaljnivå.

Jeg har hatt nytte av denne funksjonen for å sjekke at jeg var ved riktig hus (rødt). Ellers er det nok en funksjon jeg ikke kommer til å bruke veldig ofte. Tenker likevel at det er nyttig å ha den.

Finn objekter

Gjenkjenner valgte objekter som identifiseres av kameraet.

Samme bruk som beskrevet for Envision-appen.

Ring en AIRA-agent

Tilsvarende funksjon som «Ring en Ally», men med profesjonell hjelp.

Få profesjonell synstolking. 5 minutter gratis pr. dag. Ellers ulike abonnementer og minutt-pakker. Jeg har ikke hatt behov for å bruke denne tjenesten.

Batch skann

Skanne flere sider til et dokument.

Fungerer fint. Ellers samme kommentar som for annen skanning.

Finne folk

Identifiserer folk som er lagt inn og gitt navn.

Folk du vil gjenkjenne legges inn ved å ta fem bilder med Envision-appen. Når noen er lagt inn synkes det også til brillene.

Skann qr-kode

Identifiserer QR-koder og leser innholdet.

Har testet at det fungerer, men er nok en funksjon jeg ikke ser for meg å bruke mye.

Opplæring og aktuelle brukere

Jeg er vant til å teste ny teknologi. For meg er Envision Glasses enkle å lære og bruke, men jeg har nok kunnskap til å vite at dette ikke vil gjelde alle synshemmede. Jeg har holdt på med opplæring i bruk av teknologi i over 30 år. Siden Envision Glasses er såpass kostbare mener jeg at både utprøving før innvilgelse og noen timer med opplæring er riktig (for veldig mange i alle fall). Jeg vet at tanken om å utlevere hjelpemidler litt på samme måte som førerhund er foreslått mange ganger før. Dette hadde absolutt også vært en tanke med Envision Glasses: forkurs (utprøving), søknad, opplæring og test for å avgjøre om en person mestrer hjelpemiddelet (evt. Om mer opplæring er hensiktsmessig). En annen modell kan være utlån i en periode for å la brukere vurdere om brillene er et hensiktsmessig hjelpemiddel.

Opplæring/utprøving bør blant annet inneholde:

- Feste kameraet til innfatningen

- Parring og nettverkstilkobling

- Oppsett/tilpassing av hovedmenyen

- Gjennomgang/trening på fingerbevegelser

- Forklare og prøve alle funksjoner

Oppsummering

For å ta det viktigste først: Kombinasjonen av app og brille har fungert fint for meg!

Envision glasses er det hjelpemiddelet jeg forventet, og jeg hadde store forventninger. Jeg har fått til mange ting som ellers måtte ha vært droppet eller som jeg måtte ha brukt lese- og sekretærhjelp til. Kombinasjonen av disse to hjelpemidlene har gjort meg mer selvstendig. Jeg er ganske sikker på at teknologien i disse produktene representerer framtidens synshjelpemidler. Det betyr ikke at alt er perfekt, og maskinvaren i brillene trenger for eksempel en oppgradering.

Envision AI og Envision Glasses har mange av de samme funksjonene. Appen er gratis, og det kan derfor være betimelig å spørre om de kostbare brillene er verdt pengene. Jeg skal ikke prøve meg på noen kost/nytte analyse i dette notatet. Det jeg derimot vil er å si litt om erfaringene jeg har fått i løpet av testperioden.

Brillene kan brukes uavhengig av telefonen

Jeg har hatt stor nytte av Envision Glasses i to ulike scenarier:

- Begge hendene er opptatt og derfor kan ikke Envision AI brukes

- Telefonen brukes til andre ting og derfor kan ikke Envision AI brukes

Opptatte hender: Det kan eksempelvis være når jeg går med førerhund og har stokk eller noe annet i den andre hånda. På jobben har jeg da eksempelvis brukt «øyeblikkelig tekst» på brillene for å sjekke romnummer/navn. Jeg har også brukt brillene eksempelvis for å lese en elektronisk oppslagstavle på jobben når jeg har en kaffekopp i den ene hånda og hvit stokk i den andre.

Telefonen brukes til noe annet: Dette skjer daglig for min del. Jeg vil for eksempel ofte bruke Ruter-appen samtidig som jeg bruker Envision Glasses for å sjekke hvilken buss som kommer. Det hender til og med at jeg prater i telefonen! Da kan jeg bruke en av funksjonene på Envision Glasses samtidig.

Briller og app er en god kombo

Noen funksjoner fungerer best med appen. For eksempel synes jeg det er enklest med fargegjenkjenning av klesvask med appen, selv om det noen ganger er helt uvurderlig å ha hendene fri. Som en slags huskeregel: desto nærmere det du vil «se på», desto mer aktuell er appen.

Hvem kan ha nytte av brillene?

Dette er det absolutt ikke min oppgave å vurdere. Erfaringen min tilsier at dette kan være et hjelpemiddel folk kan få veldig store forventninger til, men som risikerer å havne i en skuff. Jeg har derfor antydet at opplæring/utprøving/utlån kan være riktig.